Après avoir constaté le succès du test initial d’une nouvelle option de création de rapports manuels, permettant aux utilisateurs de signaler les tweets contenant des allégations potentiellement trompeuses, Twitter est désormais étendre le test à plus de régions, avec des utilisateurs dans Le Brésil, l’Espagne et les Philippines sont désormais prêts à y accéder.

No ano passado, começamos a testar um novo mecanismo de denúncia para informações enganosas nos EUA, Coreia do Sul e Austrália.

Hoje, estamos expandindo este piloto para o Brasil, Espanha e Filipinas.https://t.co/H80pMVLTJY

— Twitter Seguro ???????? (@TwitterSeguroBR) 17 janvier 2022

Lancé en août de l’année dernière, le dernier effort de Twitter pour lutter contre la désinformation se concentre sur les tendances du public et sa perception comme un moyen de déterminer les problèmes communs avec la plate-forme et ce que les gens se sentent obligés de signaler, en indiquant des choses qu’ils ne veulent pas voir. .

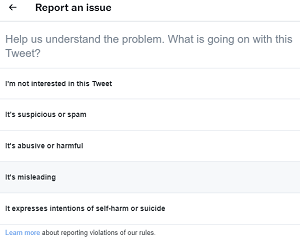

Le processus ajoute une option supplémentaire “C’est trompeur” à vos outils de signalement de tweet, offrant un autre moyen de signaler les réclamations.

Ce qui n’est évidemment pas un moyen infaillible de détecter et de supprimer un contenu trompeur – mais comme indiqué, l’idée n’est pas tant axée sur l’application directe, en tant que telle, mais davantage sur des tendances plus larges basées sur le nombre de personnes signalant certains tweets et ce que les gens signalent. .

Comme Twitter l’a expliqué dans le cadre du lancement initial :

“Bien que nous ne puissions pas agir sur ce rapport ou vous répondre directement, nous utiliserons ce rapport pour développer de nouvelles façons de réduire les informations trompeuses. Cela pourrait inclure la limitation de sa visibilité, la fourniture d’un contexte supplémentaire et la création de nouvelles politiques.”

Donc, essentiellement, le concept est que si, disons, 100 ou 1 000 personnes signalent le même tweet pour “désinformation politique”, cela attirera probablement l’attention de Twitter, ce qui peut aider Twitter à identifier ce que les utilisateurs ne veulent pas voir et veulent la plate-forme pour prendre des mesures contre, même si ce n’est pas réellement en violation des règles actuelles.

Il s’agit donc plus d’un outil de recherche que d’une option d’application – ce qui est une meilleure approche, car permettre aux utilisateurs de dicter les suppressions par des rapports de masse de cette manière pourrait certainement conduire à une utilisation abusive.

Cela, à certains égards, s’est avéré vrai lors de ses tests initiaux – comme l’explique le responsable de l’intégrité du site Yoël Roth:

“En moyenne, seuls 10 % environ des signalements de désinformation étaient exploitables, contre 20 à 30 % pour les autres domaines politiques. L’un des principaux moteurs de cette situation était les rapports « hors sujet » qui ne contiennent aucune information erronée.”

En d’autres termes, de nombreux tweets signalés via cette option manuelle n’étaient pas une préoccupation réelle, ce qui met en évidence les défis liés à l’utilisation des rapports d’utilisateurs comme mesure d’exécution.

Mais Roth note que les données qu’ils ont recueillies ont été précieuses dans tous les cas :

“Nous constatons déjà des avantages évidents de la création de rapports pour le deuxième cas d’utilisation (analyse agrégée) – en particulier en ce qui concerne les informations erronées non textuelles, telles que les médias et les URL renvoyant à des informations erronées hors plate-forme.”

Ce n’est donc peut-être pas un excellent moyen d’action directe sur chaque tweet signalé, mais en tant qu’outil de recherche, l’initiative a aidé Twitter à déterminer davantage de domaines d’intérêt, ce qui contribue à ses efforts plus larges pour éliminer la désinformation au sein de l’écosystème des tweets.

Les bots en sont un élément important, avec divers rapports de recherche indiquant que les bots Twitter sont des amplificateurs clés de la désinformation et des informations politiquement biaisées.

Début 2020, au plus fort de la crise des feux de brousse en Australie, des chercheurs de l’Université du Queensland ont détecté un vaste réseau de robots Twitter qui avaient été répandre de fausses informations sur la crise des feux de brousse en Australie et amplifier les théories du complot contre le changement climatique en opposition aux faits établis. D’autres examens ont montré que les profils de robots, parfois, contribuent jusqu’à 60 % de l’activité de tweet autour de certains événements tendances.

Twitter s’efforce en permanence de mieux identifier les réseaux de bots et d’éliminer toute influence qu’ils pourraient avoir, mais ce processus de création de rapports étendu peut aider à identifier d’autres tendances de bots, ainsi qu’à fournir un aperçu de la portée réelle des poussées de bots via des rapports d’utilisateurs étendus.

Il existe différentes façons dont une telle idée pourrait être utile, même si elle ne se traduit pas par une action directe contre les tweets offensants, en tant que tels. Et il sera intéressant de voir comment l’expansion du programme par Twitter améliore l’initiative, et comment il s’associe également à son programme de signalement “Birdwatch” en cours pour détecter l’utilisation abusive de la plate-forme.

Essentiellement, ce programme ne provoquera pas un afflux soudain de suppressions directes, éliminant les tweets offensants en fonction des sensibilités variables de chaque utilisateur. Mais cela aidera à identifier les principales tendances de contenu et les préoccupations des utilisateurs, ce qui contribuera à l’effort plus large de Twitter pour mieux détecter ces mouvements et réduire leur influence.